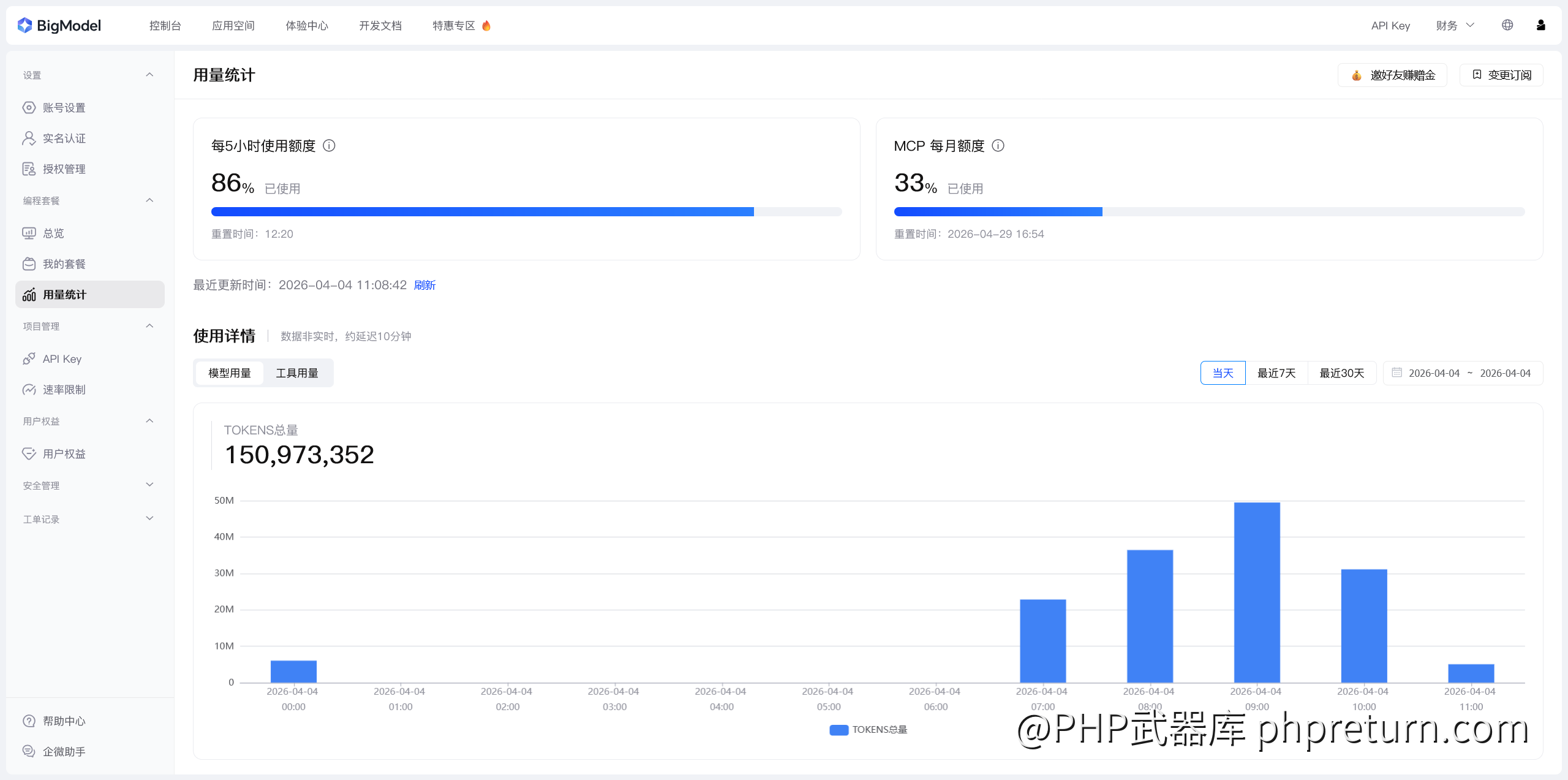

智普上线glm-5v-turbo后,第一时间申请,第二天开通,利用清明假期,GLM-5V-TURBO 消耗了近 10 亿 token。这是我的真实使用记录。

文章早就写好了,但是一直没发,又体验了一个月的龙虾内的效果,一起记录下分享给大家。

基本体验

没有乱码,前端能力好,速度稳定。目前体验阶段用量很大,连续用了三个小时,Pro 套餐才用了 86%。

遇到的坑

速度慢

比 GLM-5-Turbo 慢太多,只有晚上的时候速度能快一些。

智能感觉下降了

这一点感受最深。跟 GLM-4.7 很像——我之前写过文章介绍过,GLM-4.7 在 Trae 中很好用,但在 OpenCode 中很吃力,理解不到位、分析不准确、结果达不到预期。GLM-5V-Turbo 给了我同样的感觉。

制定的所有计划都要人工审核、重新沟通一遍才能用。有很多次让它生成测压脚本,程序能跑通,但完全没有意义,无法体现压力。后来我学了一招:计划生成后再补一句——"先给我讲解一下,你打算怎么做,做成什么样。"相当于加一道人工闸门。

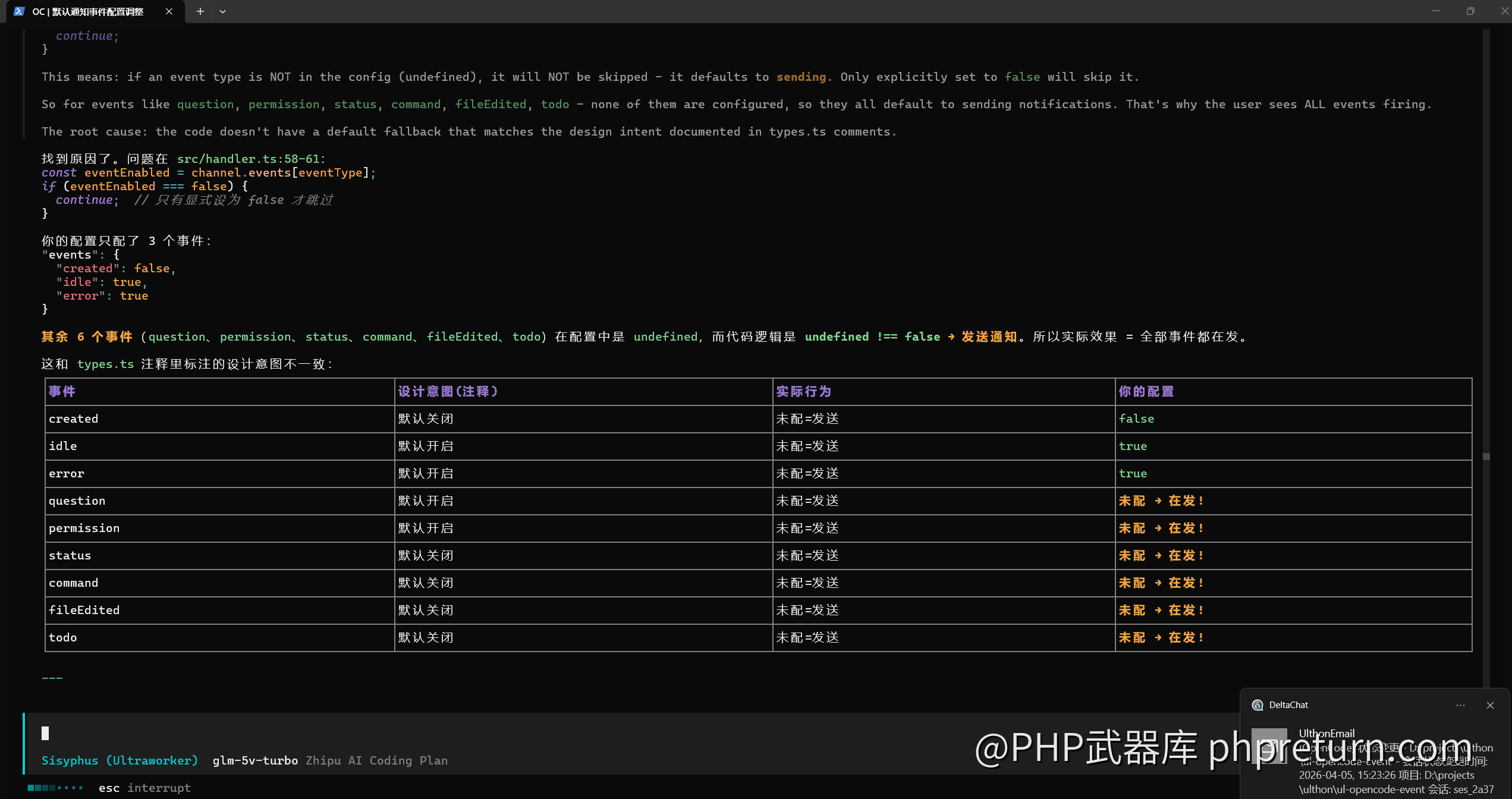

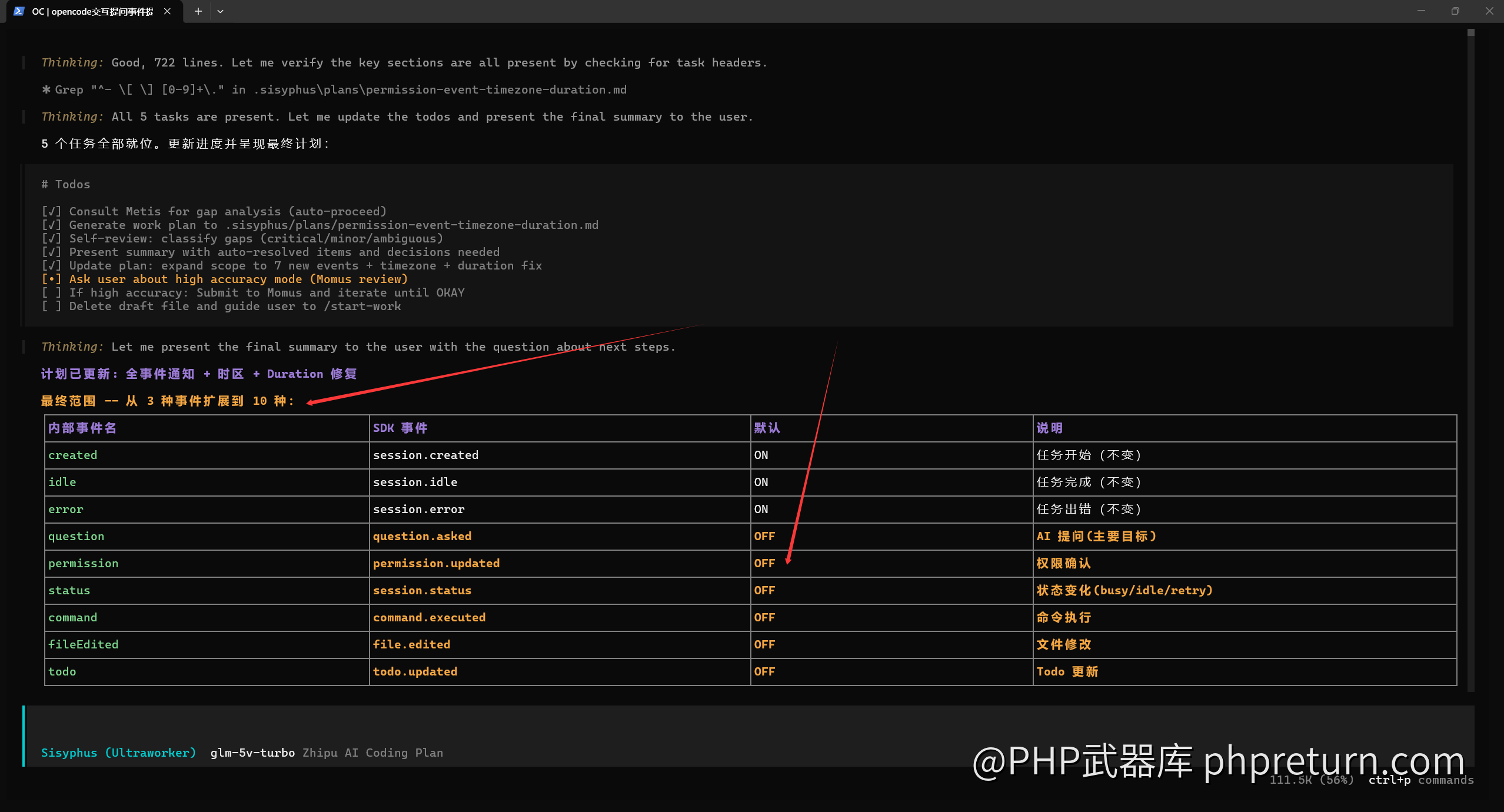

还有一个具体的例子:开发时我在计划和需求里已经明确指明了有些事件默认开启通知、有些默认不开启,但最终实现时这些区分没有被落地。

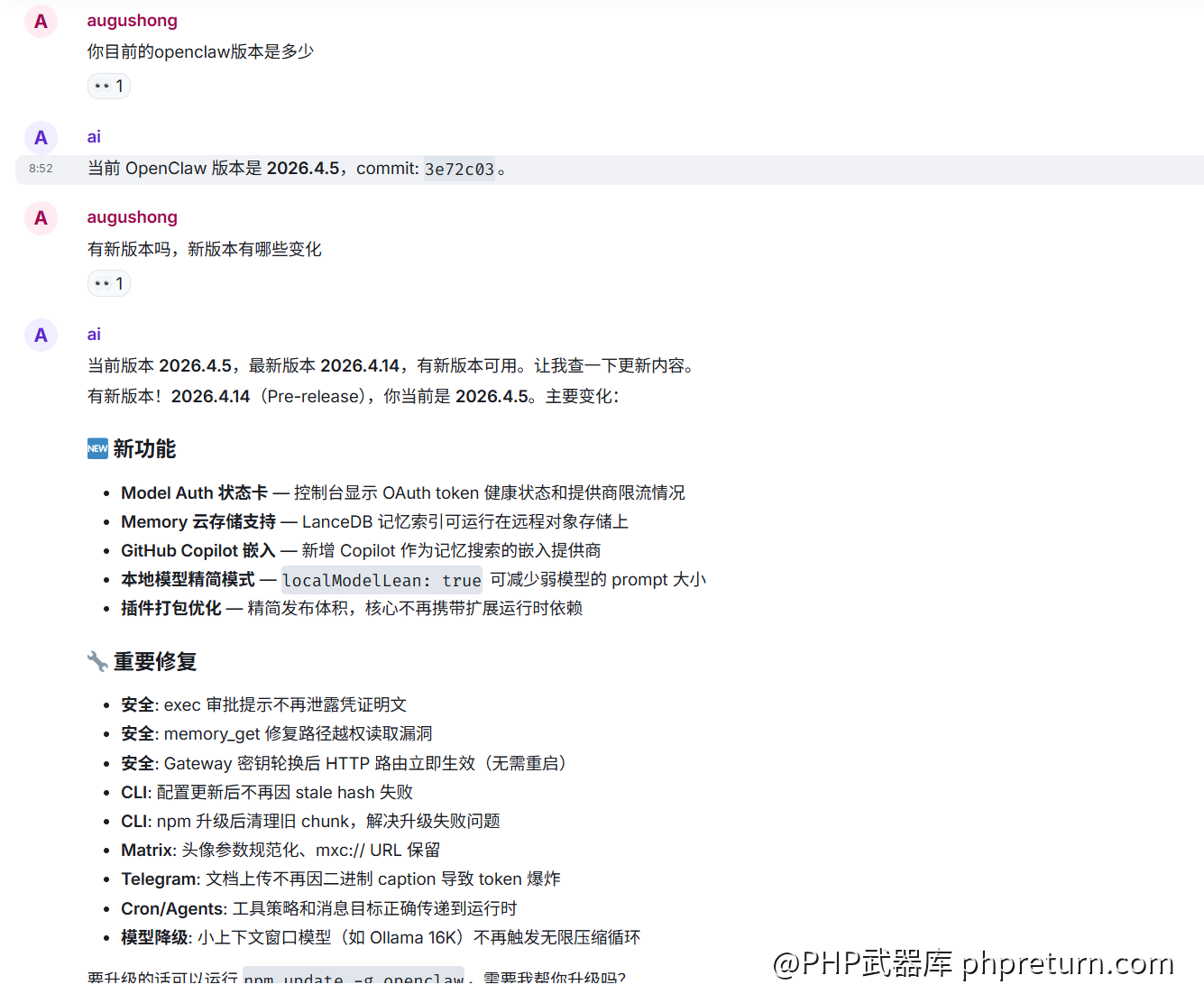

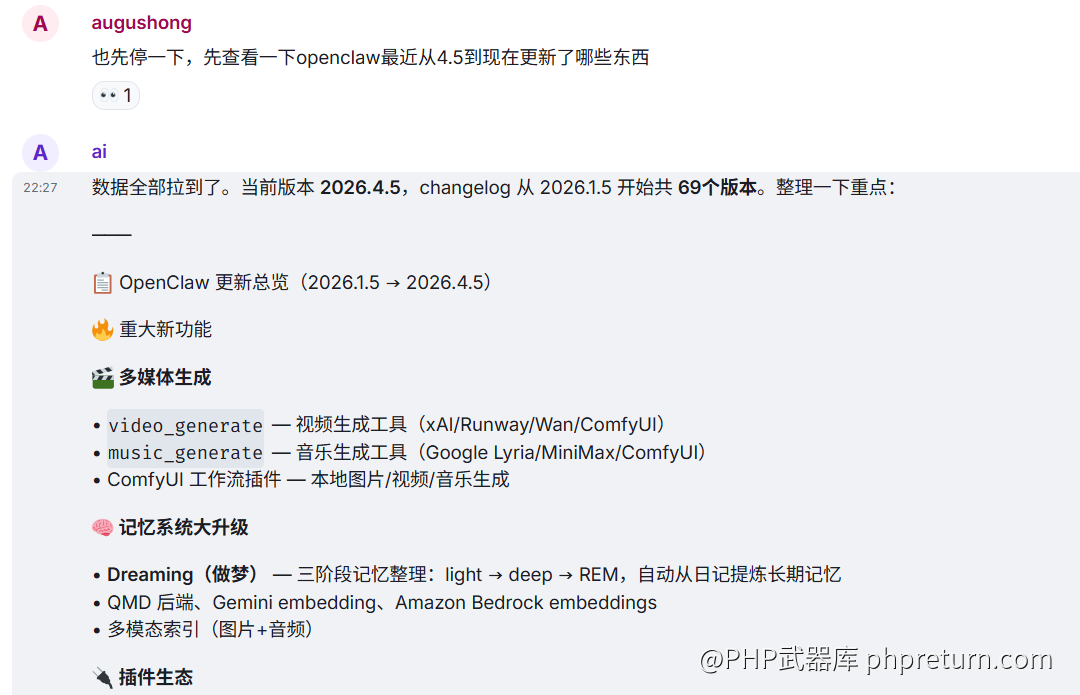

在openclaw中,明显感觉脑子不如glm-5-turbo灵光。好像是思考深度很低,只能干眼前的事,考虑不全面,还容易干错。比如我让他查询一下新版本有哪些变化,只找了最新版本,在使用glm-5-turbo的时候,会把所有新版本都总结出来。

逻辑理解也有问题,经常出现这种绕不过来的想法。我承认我的指令有点绕,但是你应该能自己绕过来才行。

下面这个命令是4月21号的时候问他的,我的意思是从4.5开始到4.21期间的版本,结果理解成了目前安装的版本是4.5,这个版本是多少。我的指令就查把当时的日期告诉他了。

规则阅读有问题

规则文档里已经写了是通过 Docker 运行的,甚至都有步骤,结果它试图在本机 Python 中运行。

注意力不集中

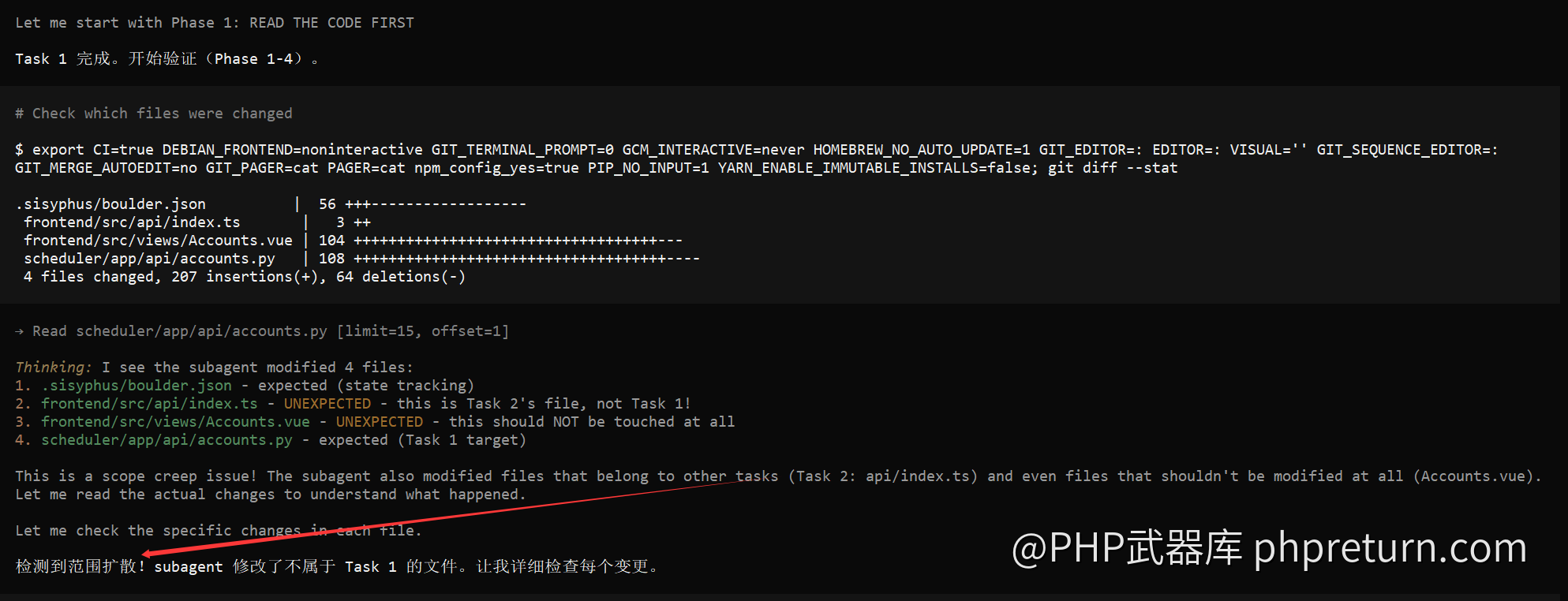

按照规则执行不到位的感觉很明显。使用 OpenCode 时经常出现子代理干错活、多干活的情况(见下图)。这种情况在使用 GLM-5、GLM-5.1、GLM-5-Turbo 时都没有出现过。

工作结果有质量问题

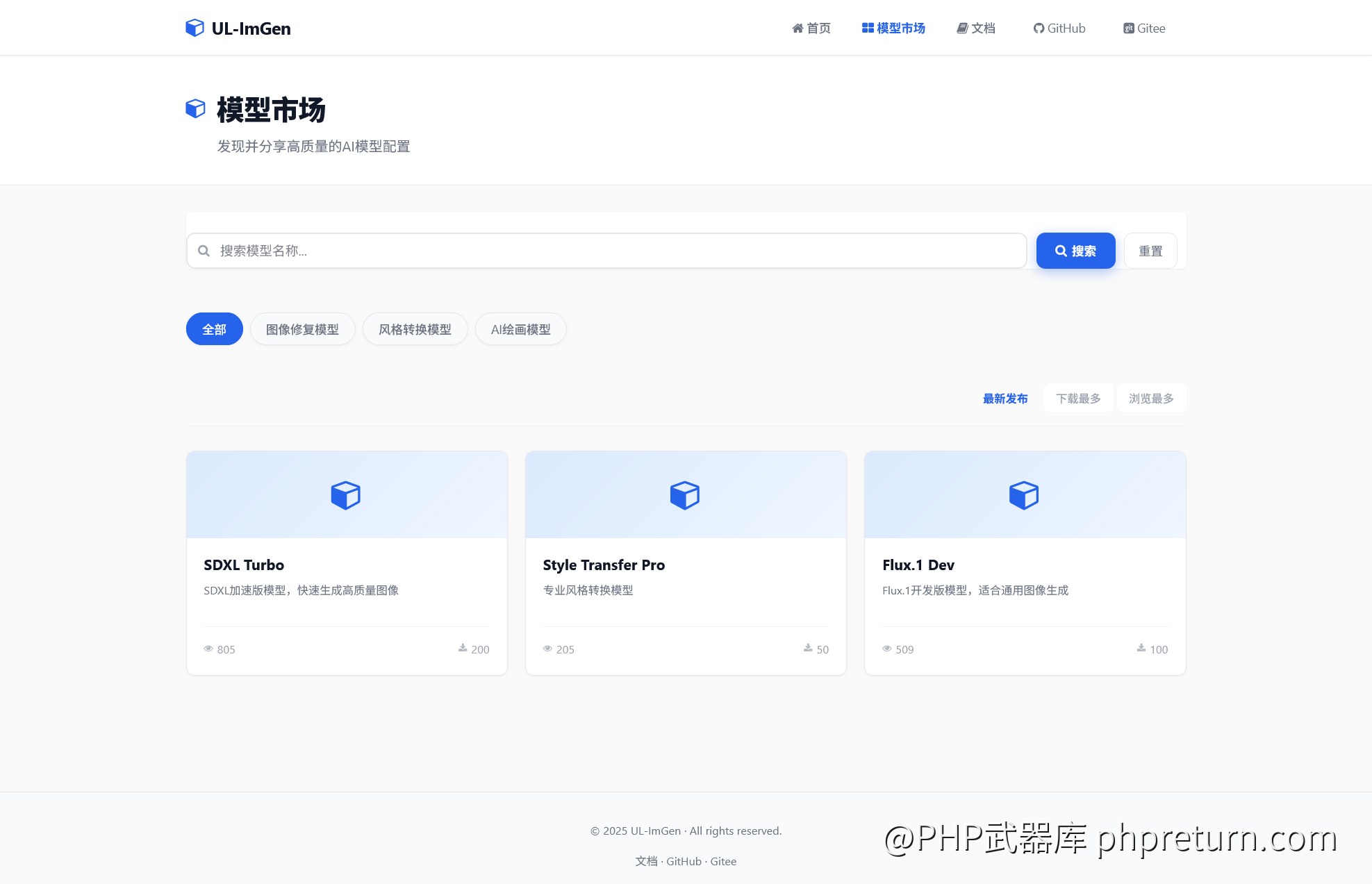

比如让它重构官网,首页的按钮颜色问题一直没有被发现。可能是视觉能力不够细致,改了很多次才改好。应该是分析源码出了问题,最后实在解决不了,直接在 HTML 的 style 里写样式才搞定。

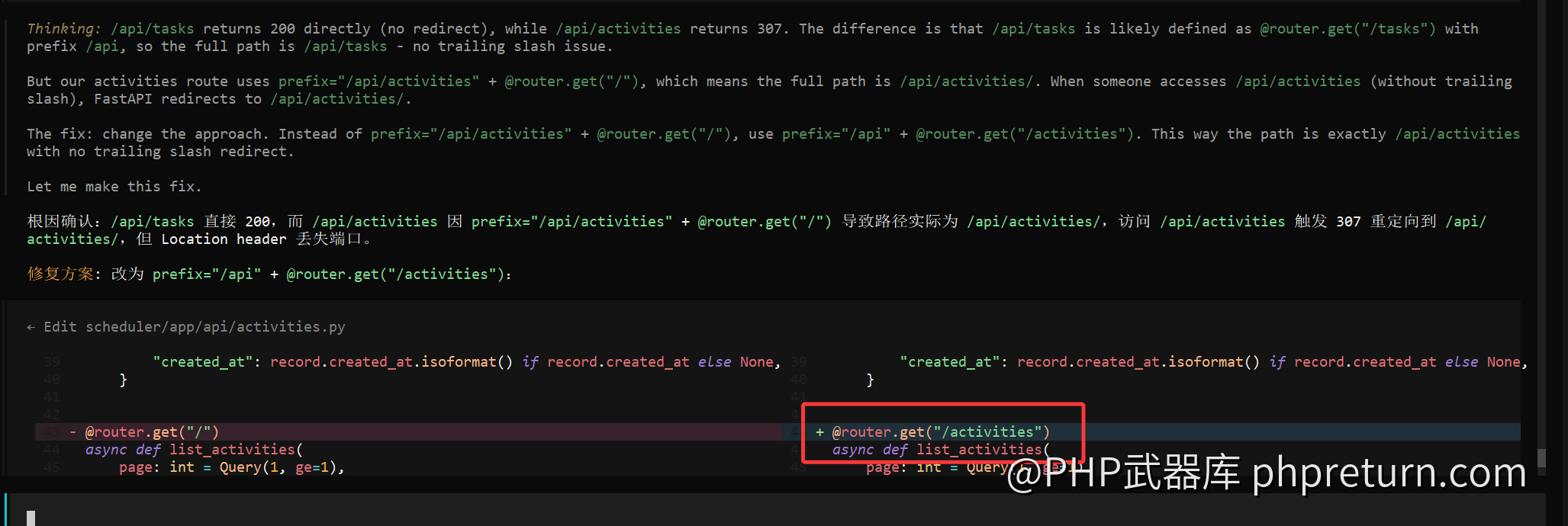

还有新增活动记录页面这种基础简单的错误也会出现(见下图)。甚至出现过计划没做完,但它报告说完成了的情况。

工具调用和身份认知也有问题

使用 OpenCode 的 Prometheus 规划者时,会话中途切换角色后,它仍然试图自己直接修改文件。被工具拦截报错后(提示"你只能修改 md,不能直接修改"),竟然还会直接委托子代理去编辑。

GLM-5、GLM-5.1、GLM-5-Turbo 也有这个情况,但它们能立即反应过来自己是规划器,回到指定计划的角色。GLM-5V-Turbo 没反应过来。

为什么还在用

总体来看我还是选择继续用 GLM-5V-Turbo。原因很简单:编程多模态这个定位优势非常大,而且能够持续稳定输出。

前端美感和交互逻辑优化很强

官网重构就是一个很好的例子。GLM 默认的行为都是那种紫色渐变风格,而 5V 考虑得更全面,问的问题也更细致。

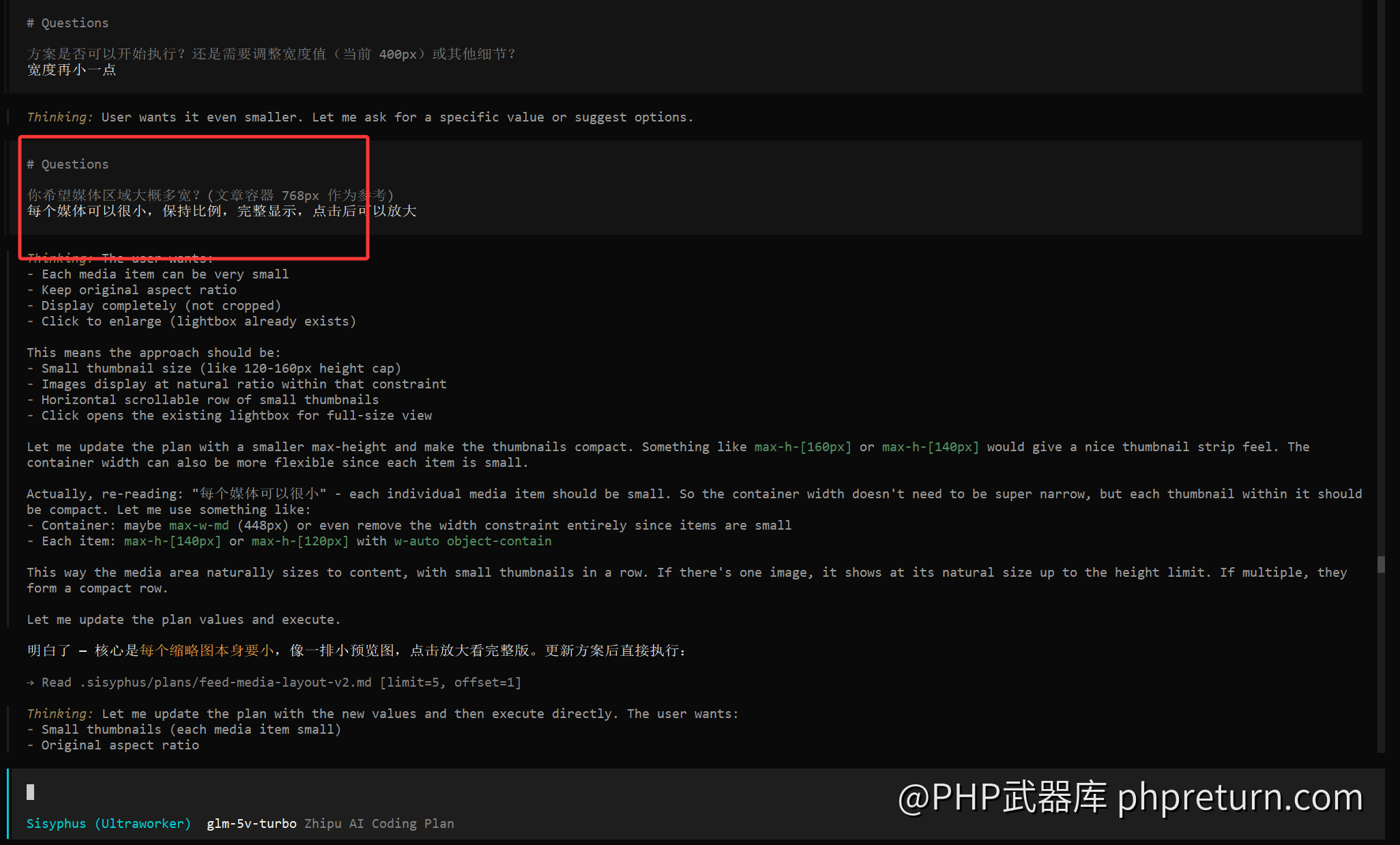

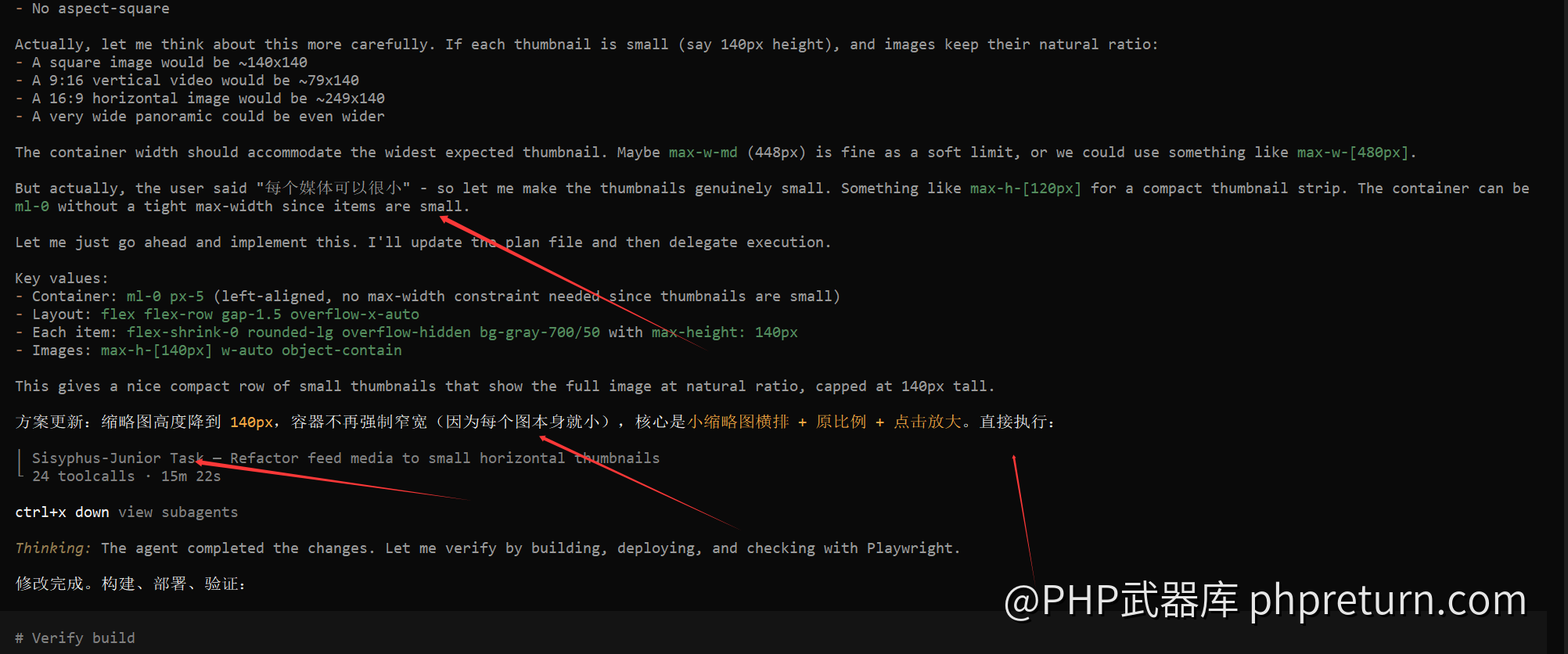

媒体区域的调整也能看出差异——它会主动考虑缩略图尺寸、容器布局这些细节。

测试方式可以改变

使用带视觉能力的模型,第二个好处是你可以把框架工程调整成让它自动测试,而不仅仅是参考和美化页面。

很多人用视觉模型只是为了让它仿制网站或者美化页面。但其实有了视觉模型之后,智能体的测试模式可以从原本的脚本测试转变为实际的操作测试——点击、填写、观察。

我的框架里专门封装了一个命令,可以模拟任何用户发起接口请求进行实际的代码业务测试。这个命令本身很有价值,如果没有它,智能体可能要专门针对项目生成一整套测试脚本才行。但现在有了视觉理解模型,它不光可以通过命令行快速验证接口,还可以针对页面进行测试、分析、浏览、交互优化。

编辑错误基本没出现过

使用 GLM-5 的时候偶尔会遇到编辑错误的问题,GLM-5V-Turbo 上基本没有。

最佳实践:怎么用效果最好

上面说了这么多缺点,但核心问题其实出在用法上——我把 GLM-5V-TURBO 当成了主力模型在用,让它干所有活。后来我调整了方案,效果非常好。

我的配置是:OpenCode + oh-my-openagent 插件。

- 主力模型:GLM-5.1 — 负责代码编写、架构设计、逻辑推理这些需要强智能的工作

- multimodal-looker 配置为 GLM-5V-TURBO — 只负责"看",通过 look_at 工具查看页面、截图、设计稿,然后返回分析结果给主力模型

- frontend 也配置GLM-5V-TURBO

这样分工之后,GLM-5V-TURBO 不再需要做复杂的逻辑判断和计划制定,它只需要做好一件事:看清楚、说清楚、写清楚。而 GLM-5.1 依然保持它擅长的代码能力和推理能力,两者各司其职。

我之前还专门搭建了一个paddleORC服务,封装成技能来辅助视觉理解,但是现在用不到了,用glm-5v-turbo理解文字很到位。

在这个配置下,look_at 工具的表现非常好。前端调整、页面测试、UI 还原这些场景,视觉模型只负责输入,主力模型负责决策和执行,前面提到的那些注意力分散、角色混乱、计划执行不到位的问题基本都消失了。

这里再推荐一下opencode的oh-my-openagent插件(原名oh-my-opencode,大家说的omo),他将视觉理解专门封装成一个智能体,这样的话不要求主智能体具备视觉理解能力,很到位的设计。也吐槽一下opencode最近升级的功能,每次粘贴图片路径都不再是文本,而是一个图片附件,导致当前智能体必须具备视觉理解,这个设计不够细节,应该是识别一下,当模型支持视觉理解时才这样,否则还是按图片路径输入更好。

原文标题: 4天花10亿,glm-5v-turbo体验笔记

原文地址: https://phpreturn.com/index/a69ede6ac94a7d.html

原文平台: PHP武器库

版权声明: 本文由phpreturn.com(PHP武器库官网)原创和首发,所有权利归phpreturn(PHP武器库)所有,本站允许任何形式的转载/引用文章,但必须同时注明出处。